Un estudio de la Universidad de Harvard advierte que los modelos de Inteligencia Artificial muestran menor precisión según género

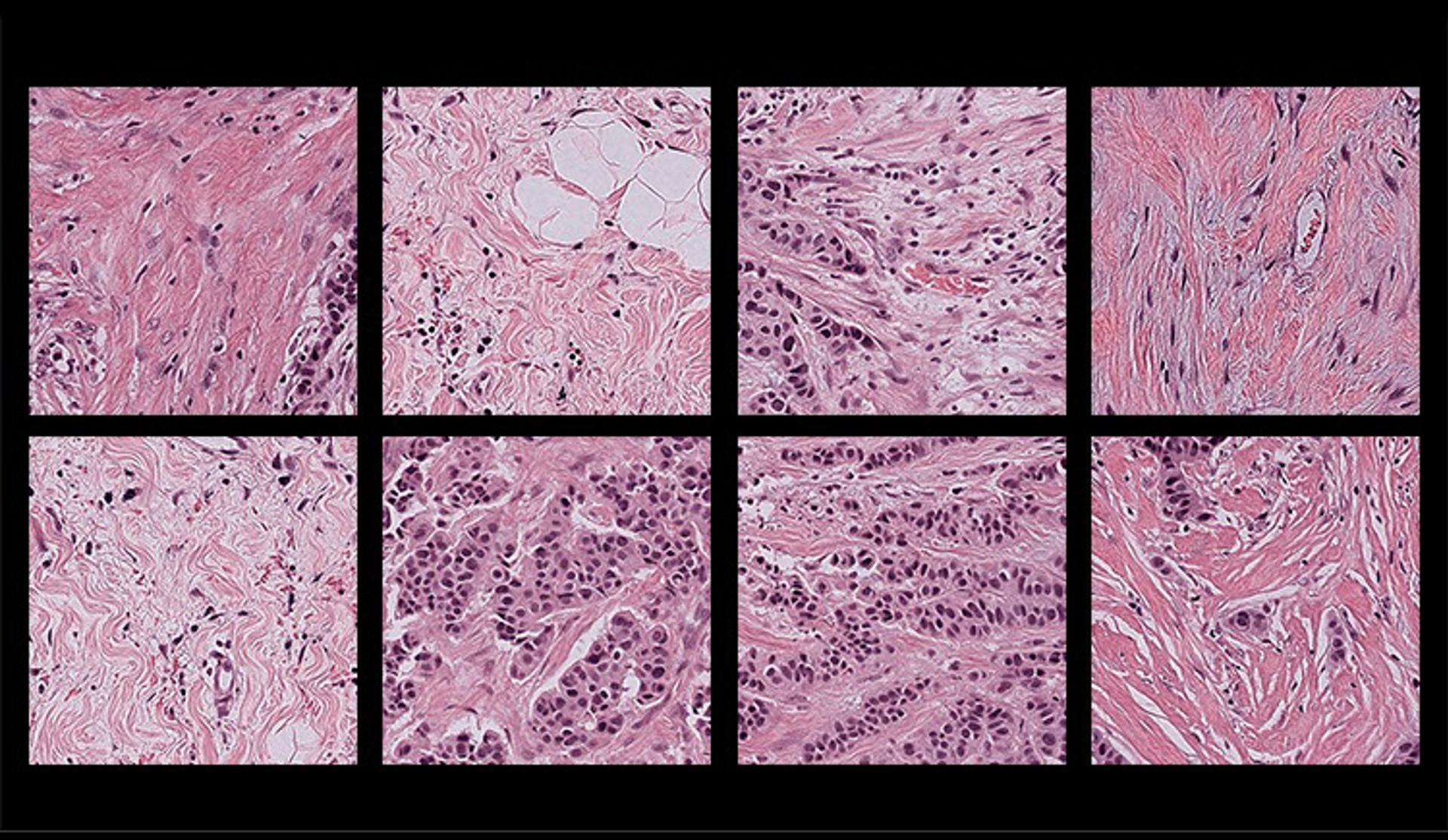

El uso de la Inteligencia Artificial (IA) en el análisis de muestras patológicas ha marcado un avance significativo en el diagnóstico del cáncer, sin embargo, un nuevo estudio liderado por investigadores de la Universidad de Harvard reveló que estos modelos presentan sesgos demográficos que pueden disminuir su eficacia, y desarrolló una herramienta para corregirlos, informó la agencia EFE.

La investigación, publicada en la revista Cell Reports Medicine, analizó los cuatro modelos de IA más utilizados en patología oncológica y encontró un rendimiento desigual en la detección y diferenciación de tumores según el género, la raza y la edad de los pacientes.

“Para un patólogo humano, una muestra de tejido es como corregir un examen sin nombre, la diapositiva revela la enfermedad, pero no datos del paciente. Nos sorprendió descubrir que la IA sí puede inferir esa información”, explicó Kun-Hsing Yu, investigador en informática biomédica y patología en Harvard.

Los científicos entrenaron los modelos con un amplio repositorio de diapositivas correspondientes a 20 tipos de cáncer y comprobaron que todos mostraban menor precisión diagnóstica en determinados grupos poblacionales.

Entre los hallazgos, se detectaron dificultades para diferenciar subtipos de cáncer de pulmón en hombres afroamericanos, tumores de mama en pacientes jóvenes y deficiencias en la detección de cáncer de mama, riñón, tiroides y estómago en grupos específicos.

En términos generales, los investigadores identificaron deficiencias en el 29% de las tareas diagnósticas realizadas por los modelos, y según Yu, esto ocurre porque la IA logra extraer información demográfica de las diapositivas y se apoya en patrones poblacionales sesgados para emitir diagnósticos.

El estudio atribuye estos sesgos a varios factores, entre ellos el entrenamiento de los modelos con muestras desiguales entre poblaciones y las diferencias en la incidencia de ciertos tipos de cáncer según el grupo demográfico.

Además, los sistemas de IA detectan variaciones moleculares y mutaciones genéticas más frecuentes en algunos grupos, lo que puede afectar la precisión cuando se aplican a poblaciones donde esas mutaciones son menos comunes.

Para enfrentar este problema, el equipo desarrolló FAIR-Path, una herramienta basada en aprendizaje automático contrastivo que modifica el entrenamiento de la IA para priorizar las diferencias relevantes -como los tipos de cáncer- y minimizar las diferencias demográficas, con su aplicación, las deficiencias diagnósticas se redujeron en aproximadamente un 88%.

“El hallazgo es alentador porque demuestra que el sesgo puede reducirse incluso sin disponer de datos completamente justos y representativos”, señaló Yu.

Actualmente, los investigadores colaboran con instituciones de distintos países para evaluar el alcance de estos sesgos en contextos demográficos y clínicos diversos, y trabajan en adaptar FAIR-Path a entornos con tamaños de muestra limitados.

El objetivo final, subrayaron, es desarrollar modelos de IA patológica más equitativos que contribuyan a mejorar la atención oncológica a nivel global.